榴莲推广APP网站入口官网,会计专家黄世忠║人工智能的十大ESG风险:解构与缓释 芯片需求和算力扩张导致电力与水资源过度消耗

- 生活常识

- 2025-11-30 16:43:03

- 1

炒股就看,权威,专业,及时,全面,助您挖掘潜力主题机会!

来源:财会月刊

原载《财会月刊》2026年第01期

【摘要】人工智能(AI)作为新一轮数智化技术革命的主力军,不仅在提升全要素生产率、促进经济社会发展、重塑生产生活方式等方面发挥积极的作用,而且将赋能全人类积极应对气候变化。但AI在发展过程中潜藏的ESG(环境、社会、治理)风险逐渐显现,理应予以充分关注。本文系统解构AI的十大ESG风险。在环境议题方面,AI引发的芯片需求和算力扩张导致电力与水资源过度消耗,留下大量的碳足迹以及矿物消耗和废弃物等环境足迹。在社会议题方面,AI对就业岗位的挤出效应导致薪资与生产力进一步脱钩,加剧了劳动力市场失衡和社会不公平。在治理议题方面,算法歧视、AI滥用以及数据安全带来全新的治理挑战。缓释AI的ESG风险,确保AI健康可持续发展,必须推动AI向绿色化与循环化转型、完善就业保障和分配机制、强化伦理建设和建章立制。

【关键词】人工智能;环境风险;社会风险;治理风险;风险缓释【基金项目】国家社会科学基金项目“气候信息披露规则与产品碳足迹管理机制研究”(项目编号:24BGL094);国家自然科学基金项目“基于利益相关者视角的财务舞弊识别及应用”(项目编号:72172135)

一、引言

近年来,以ChatGPT和DeepSeek为代表的生成式人工智能(AI)技术取得重大突破,正以各种方式在制造业和服务业推广运用。麦肯锡针对16个业务领域中63个应用场景的研究显示,AI将显著提升全要素生产率、催生新业态新机遇,预计每年可带来2.6万亿 ~ 4.4万亿美元的经济增加值(McKinsey,2023)。除促进经济增长外,AI还可在工业生产能耗优化、智能电网高效调度、建筑能耗动态管控、交通运输减排提效、农业种植精准滴灌、研发设计提质增效、供应链协同化脱碳、碳足迹追踪与管理等领域进行技术赋能,为人类社会节能降耗、减少温室气体排放、共同应对气候变化提供技术支撑。但在看到AI对绿色低碳转型发挥促进作用的同时,也应充分关注杰文斯悖论(Jevons Paradox),客观评估AI发展的潜在不利影响。英国经济学家、逻辑学家威廉·斯坦利·杰文斯(William Stanley Jenovs)于1865年出版了《煤炭问题》(The Coal Question)一书,提出的观点彻底颠覆了人们对技术进步与资源消耗相互关系的认知。他指出瓦特通过改良蒸汽机极大提高了煤炭使用效率,大幅降低了煤炭使用成本,结果却导致煤炭总消耗量以前所未有的速度增长。他观察到的“效率显著提升——成本大幅降低——需求急剧增加——总消耗量不降反升”这一有违常理的“反弹效应”(Rebound Effect)被学术界称为“杰文斯悖论”。谷歌、苹果、微软等数字化平台企业近年来通过使用AI节能技术和清洁能源,虽然大幅降低了单位能耗和温室气体排放强度,但用电量、用水量和碳排放却呈上升态势,这雄辩地说明19世纪提出的杰文斯悖论到了21世纪依然存在。

联合国贸易和发展会议(UNCTAD)在《2024数字经济报告:打造具有环境可持续性和包容性的数字未来》(简称“UNCTAD报告”)中敏锐地指出,以AI、大数据、云技术、物联网为代表的数字化不仅留下了大量环境足迹(能源和材料消耗产生的碳足迹、水足迹、矿物消耗和废弃物等),而且加剧了社会不公平(UNCTAD,2024),提示我们在发展AI的过程中应当高度警惕AI可能给经济、社会和环境带来的意想不到的负外部性。AI迅猛发展和普及应用潜藏的ESG(环境、社会、治理)风险不容小觑,数据中心的耗电耗水和碳排放、劳动力市场的结构性冲击、算法应用的伦理争议等ESG问题,正成为制约AI可持续发展的瓶颈。加强这方面的研究,对于确保AI健康可持续发展意义重大。现有研究大多聚焦AI的技术创新与经济效应,对AI发展中的ESG风险进行系统分析的研究严重匮乏。本文系统解构AI发展中的十大ESG风险,剖析AI全生命周期的耗电耗水、碳排放以及矿物消耗等环境风险,分析AI对就业岗位产生冲击、生产力提升与劳动者报酬脱钩、马太效应加剧等社会风险,指出算法歧视、AI滥用以及数据安全带来的隐私权危机等治理风险,并从ESG的角度提出风险缓释建议,希望能为政策制定者提供风险预警,为企业和个人善用AI提供有益启示。

二、AI的环境(E)风险:算力扩张的生态代价

AI的有效运行高度依赖处理与高强度算力支撑,从软硬件生产到模型训练再到问题推理的全生命周期,均带来巨大的环境资源压力。概而言之,AI的环境(E)风险主要体现在电力消耗、水资源消耗、碳排放、矿物消耗与废弃物四个方面。

(一)电力消耗:AI的尽头是电力

首先,AI相关的硬件制造属于能源密集型环节,但在整个生命周期中其能耗低于运营阶段。硬件制造最耗电的是芯片制造(含GPU/TPU,即图形处理器和张量处理器)以及数据存储设备制造环节。国际能源署(IEA)于2025年4月发布的《世界能源展望特别报告:能源与人工智能》(简称“IEA报告”)显示,以目前最先进的3纳米芯片为例,每片晶圆的制造过程需消耗约2.3兆瓦时(2300度)电能。对于高性能的服务器配置,制造环节的能耗超过10兆瓦时,而五年使用周期的运营能耗则超过80兆瓦时。在制造环节的总能耗中,约60%的能耗用于晶圆及半导体生产(沉积、光刻和蚀刻工艺占主要部分),其余40%的能耗主要用于设施冷却等辅助流程(IEA,2025)。

绿色和平组织于2025年5月发布的《人工智能环境影响报告》(简称“绿色和平组织报告”)指出,2023年全球半导体行业消耗了超过100太瓦时(1000亿度)电能,相当于全球制造业耗电量的1%(Green Peace,2025)。仅台积电2024年的耗电量就高达274.70亿度(TSMC,2025),相当于通用汽车同年在全球范围内生产和销售537万辆汽车耗电量的4.96倍(General Motors,2025),如表1所示。

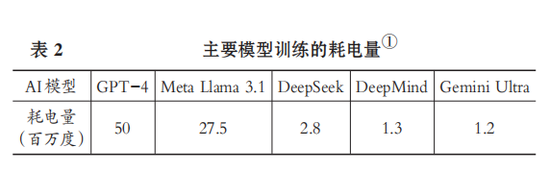

其次,大语言模型的训练和推理极其耗电,堪称“电老虎”。斯坦福大学人工智能研究所发布的《2023年人工智能指数报告》显示,训练一次GPT-3的耗电量多达1.28吉瓦时(Stanford,2023)。更为严重的是,随着AI大模型参数规模从百亿级向万亿级突破,训练AI的能耗呈指数级增长。专注于AI环境资源影响的网站All About AI发布的《2025年AI环境统计》报告列示了五大AI模型训练的耗电量,如表2所示。

美国能源信息署(EIA)的数据显示,2024年美国家庭年平均耗电量约10500千瓦时,训练一次GPT-4的耗电量足够4762个美国家庭使用一年。值得注意的是,AI在响应用户查询和提问时进行推理的耗电量更加惊人,而推理约占AI能源消耗的60% ~ 70%②。AI的电力消耗已经引起公众的关注,OpenAI首席执行官萨姆·奥特曼(Sam Altman)2024年初在达沃斯会议上不得不承认,AI技术消耗的电力将远超人们预期。

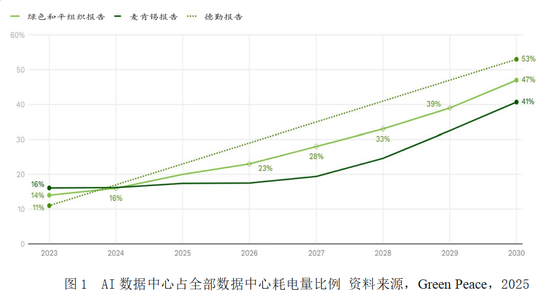

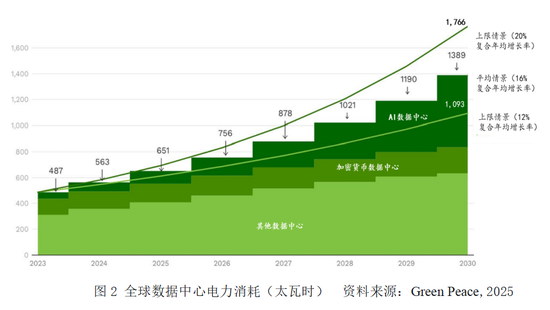

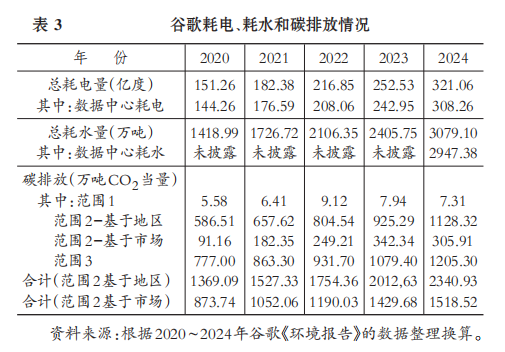

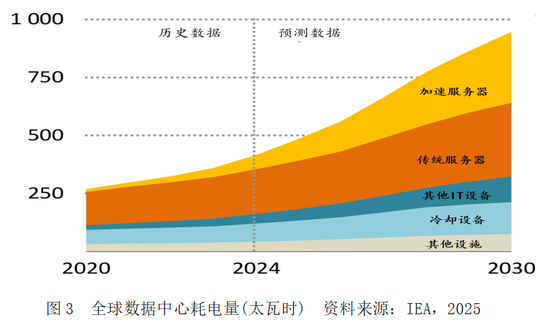

数据中心是AI最重要的算力基础设施,AI的训练和推理主要在数据中心完成。根据绿色和平组织报告,全球AI数据中心耗电量占全球数据中心耗电量的比重将从2024年的16%猛增至2030年的53%(如图1所示),全球数据中心耗电量将从2024年的563太瓦时(5630亿度)猛增至2030年的1385太瓦时(13850亿度)(如图2所示)。若按53%的全球AI数据中心用电量占比测算,2030年全球AI数据中心耗电量(7340亿度)约占2024年日本耗电量(1.03万亿度)的71%、相当于德国耗电量(4640亿度)和英国耗电量(2510亿度)之和的103%。全球数据中心最近几年的耗电量之所以快速增加,最根本的原因是AI高速发展和大量普及。从表3可以看出,谷歌耗电量从2020年的151.26亿度增至2024年的321.06亿度,复合年均增长率为20.7%,其中数据中心的耗电量更是从2020年的144.26亿度飙升至2024年的308.26亿度,复合年均增长率高达20.89%。谷歌在其2024年可持续发展报告中解释了数据中心耗电量增加的原因,主要是发展Gemini大模型AI等技术所致(Google,2025)。

相比之下,IEA的估算更加接近图2的下限情景。根据IEA的估计,全球数据中心的耗电量将从2024年的415太瓦时(4150亿度)增至2030年的945太瓦时(9450亿度),如图3所示。

(二)水资源消耗:数据中心散热的隐性成本

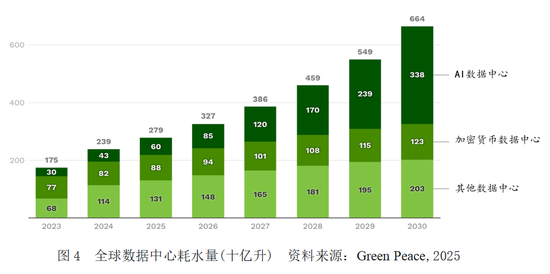

AI数据中心计算、存储、网络、散热与供电设施在运算、运转过程中产生的热量需大量水资源冷却,AI大模型训练期间和响应用户查询提问的推理过程耗水量惊人。绿色和平组织报告表明,在AI发展的推动下,全球数据中心的耗水量将从2024年的2390亿升(2.39亿吨)增至2030年的6640亿升(6.64亿吨),其中全球AI数据中心的耗水量更是从430亿升(0.43亿吨)猛增至2030年的3380亿升(3.38亿吨),复合年均增长率高达40.99%,远高于全球数据中心18.35%的复合年均增长率,详见图4。

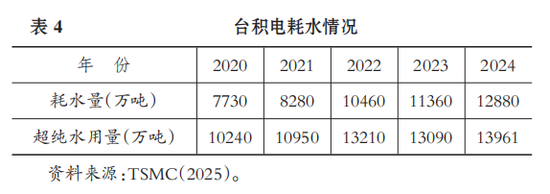

除了AI数据中心,用于AI计算的GPU等芯片制造对水资源的消耗更加惊人。以2024年第四季度在全球晶圆制造的市场份额高达67%的台积电为例,其耗水量和超纯水用量分别从2020年的5690万吨和7970万吨增至2024年的12880万吨和13961万吨,如表4所示。假设台积电三分之一的耗水量与AI芯片制造有关,则其2024年耗水量将高达4250万吨,与同期全球AI数据中心4300万吨的耗水量相差无几。

在水资源匮乏或用水压力大的地区,AI芯片制造、模型训练和推理运行过程中的高耗水极易引发社会矛盾。水是维持生命的基本要素,但在全球范围内水尤其是淡水是一种十分稀缺的资源。虽然地球70%的表面被水覆盖,但97%的水都是咸水,在剩余3%的淡水中,仅有不到1%的淡水可以从降雨以及河流和湖泊中获取(黄世忠和叶丰滢,2024)。因此,AI与人和动植物争水的问题是一个必须高度关注的环境议题,AI相关产业的水资源消耗情况和由此导致的生态环境压力,理应在可持续发展报告中予以充分披露。

(三)碳排放:全生命周期的环境足迹

AI的碳足迹覆盖硬件生产与模型运行全链条。GPT-3训练要排放552吨CO2当量(Stanford,2025),假设一辆小汽车每百公里消耗10升95号汽油,每升产生2.3公斤CO2,则训练GPT-3产生的552吨CO2当量相当于480辆这种小汽车每年行驶5000公里的碳排放。高科技、高耗能、高排放的特性由此可见一斑。

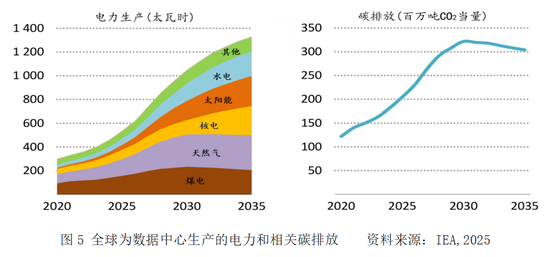

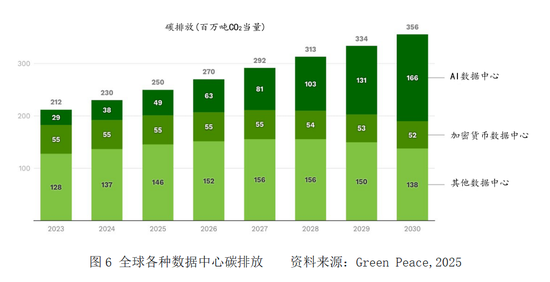

IEA报告显示,全球数据中心生产需要的电力预计将从2024年的460太瓦时(4600亿度)增加至2030年的1000太瓦时和2035年的1300太瓦时(13000亿度),假设2024 ~ 2030年增加的电力中一半来自可再生能源,其余来自煤炭和天然气,2030 ~ 2035年新增电力主要通过核电解决,则2030年全球数据中心的碳排放将达到3.2亿吨的峰值,2035年随着核电和其他可再生能源的普及,全球数据中心的碳排放有望回落至3亿吨,如图5所示。按照绿色和平组织报告,以AI数据中心耗电量占全部数据中心耗电量53%测算,到2030年AI数据中心的碳排放约为1.696亿吨[这与绿色和平组织测算的1.66亿吨相当接近(见图6)]。我国三大航空公司披露的2024年碳排放(只披露范围1和范围2排放,未披露范围3排放)合计为8112.39万吨CO2当量(其中国航2788.2万吨、南航2927.06万吨、东航2397.13万吨),这意味着,2030年全球AI数据中心的碳排放相当于我国三大航空公司2024年碳排放总和的209%。而根据All About AI的数据可知,截至2025年8月的12个月里,美国AI和其他数据中心的碳排放占美国碳排放总量的2.18%,略微超过美国航空业同期的碳排放占比。

(四)矿物消耗与废弃物:提升效率的资源代价

现有研究鲜有直接涉及与AI相关的矿物消耗和废弃物,但UNCTAD报告提供的数据足以让我们管窥AI发展可能产生的资源足迹和废弃物足迹。诚如该报告所指出的,许多人误以为数字经济是虚拟无形的,或发生在“云端”,但数字化其实严重依赖物质世界和原材料。AI的普及离不开数字设备、其他硬件和基础设施,而这些设备、硬件和设施中包含着数十种矿物和金属。据估计,制造一台2千克重的电脑需要消耗800千克的原材料(UNCTAD,2024)。

值得关注的是,以AI为代表的数字化使用的关键矿物和金属包括铝、钴、铜、金、锂、锰、天然石墨、镍、铂、稀土元素、金属硅,与向绿色化转型所需的矿物和金属高度重叠。全球正掀起的数字化和绿色化双转型浪潮,极大刺激了对这些矿物和金属的需求。到2050年石墨、锂和钴等矿物的消耗量预计将增加500%,铂族矿物的消耗量预计比2022年高出120倍(UNCTAD,2024)。在数字化和绿色化双转型的刺激下,这样的资源消耗显然超过了整个星球的承载力,故而不可持续。再加上数字化和绿色化双转型所需的矿物和金属分布及其加工制造很不均匀(如刚果民主共和国钴产量占全球产量的68%;澳大利亚和智利的锂产量占全球产量的77%;加蓬和南非的锰产量占全球产量的50%;中国的天然石墨、金属硅、稀土元素产量的全球占比分别为65%、78%和70%,铝、钴和锂矿物加工量占全球的一半以上,锰和稀土元素加工量的全球占比更是高达90%),这一方面可能使具有资源禀赋优势的国家在转型中获得发展先机,另一方面可能导致这些国家在矿物开采和加工过程中产生大量碳排放,还可能引发地缘政治和经贸摩擦。

以AI为代表的数字化技术不断迭代,由此产生的废弃物的处理成为另一个值得高度关注和迫切需要加以解决的环境问题。UNCTAD报告显示,2010 ~ 2022年,全球废弃的智能手机、笔记本电脑、显示屏和其他电子设备增加了30%,达到1050万吨,但2022年全球只有24%的电子废弃物得到正式收集。对这类废弃物的回收和循环利用任重道远。

三、AI的社会(S)风险:技术红利的分配失衡

AI在社会议题上的风险集中体现为劳动力市场重构与收入分配恶化,其创造性破坏(Creative Destruction)③效应不仅未能实现包容性增长,反而导致就业挤出效应、薪资与生产力脱钩、社会公平受损等社会问题。AI发展进程中的公正转型(Just Transition)任重道远。

(一)就业挤出效应:劳动力市场的结构性失衡

AI对就业的挤出效应呈现“跨技能层级”扩散特征。传统观点认为,AI主要替代低技能岗位,但生成式AI的发展已将替代范围扩展至中高技能领域。

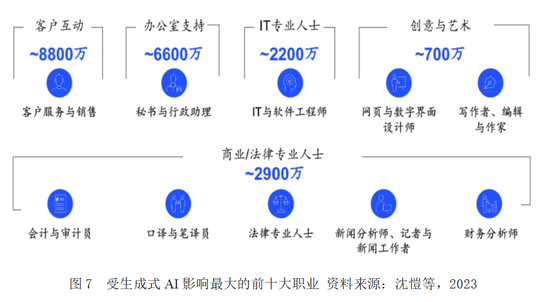

麦肯锡的研究认为,生成式AI及其他AI技术有望将如今占据员工60%~70%时间的工作任务自动化。自动化潜力的加速提升,主要源于生成式AI理解自然语言的能力显著增强,而自然语言理解能力正是完成很多工作任务所必须具备的。因此,生成式AI对知识型工作岗位的影响更大,这类工作岗位通常对应教育程度要求和薪资水平更高的职业。根据沈愷等(2025)的研究,在中国,包括会计、审计和财务分析师在内的十大职业首当其冲受到生成式AI的影响,具体如图7所示。

鉴于AI特别是生成式AI和具身AI(Embodied AI)带来的技术自动化的大幅跃升,劳动力转型的速度可能高于预期,就业挤出效应将从白领岗位逐步向蓝领岗位蔓延。采用涵盖了技术发展、经济可行性及推广时间线的最新技术应用场景研究显示,当下50%的工作任务有望在2030年至2060年间实现自动化,未来将导致3亿个工作岗位被AI替代(McKinsey,2023)。

值得注意的是,AI对就业市场的冲击呈现阶段性演进特征。在技术应用初期,AI更多以效率增强工具的角色融入工作场景,例如辅助数据整理、优化流程效率或自动化重复性操作,这一阶段不仅不会直接挤占岗位,反而可通过提升人均产出间接创造新的协作型岗位需求。但随着算法迭代、多模态能力突破及行业渗透率提升,AI对具体工作任务的替代比例将进入上升通道,其对就业市场的实质性影响将显著增强。

关于AI对就业的影响程度,不同机构的研究结论不尽一致。2024年,美国商务部发布的就业市场调查报告显示,在制造业、服务业和财务管理等领域,AI的应用仍以赋能为主,短期内推动了岗位结构优化而非绝对数量减少,部分企业甚至因效率提升而扩大了招聘规模。然而,美国兰德公司同期发布的研究报告认为这种“AI促就业”的短期趋势难以延续。报告预测,未来5 ~ 10年全球就业市场将进入AI的集中替代期,届时替代范围将从低技能重复性工作,逐步延伸至法律文书处理、基础数据分析、初级设计等知识型工作领域,传统认知中不易被替代的岗位将不再具备天然优势(RAND,2025)。DeepSeek资深研究员陈德里持相同看法,他在2025年世界互联网大会上指出:未来3 ~ 5年为蜜月期,人类可与AI协同创造更大的价值;5 ~ 10年为风险上升期,开始出现岗位替代,失业风险上升;10 ~ 20年为秩序挑战期,AI可能取代市场上大多数工作,对现有社会秩序构成重大挑战④。

更需警惕的是,AI冲击下的就业市场可能面临结构性失衡风险。被 AI替代的劳动力群体,往往需要掌握全新的数字技能或跨领域能力才能重新进入就业市场,但受制于学习成本、学习能力、年龄门槛和技术迭代等因素,相当一部分劳动者难以在短期内完成知识更新和能力提升,导致部分群体长期被就业市场拒之门外,对社会就业稳定与收入分配公平构成潜在挑战。

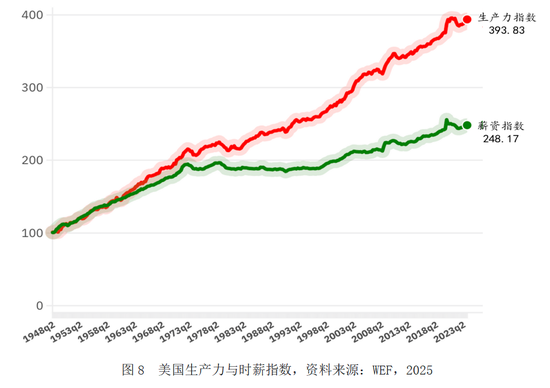

(二)薪资与生产力脱钩:分配机制的系统性失灵

薪资与生产力脱钩(Decoupling of Wages from Productivity)是指,技术进步提高了生产力却没有相应转化为劳动者报酬的增加,甚至导致劳动者报酬在收入分配中的占比不升反降,形成技术进步红利被截留的现象。尽管这种脱钩现象由来已久,但从图8可以看出,2018年以ChatGPT为代表的生成式AI加速了这种脱钩进程。究其原因:一是AI加剧了替代效应(Displacement Effect),即AI取代劳动力,减少对劳动力的需求,降低了劳动者的议价能力,从而抑制薪资的上涨;二是AI具有资本密集型特征,企业采用AI技术的核心目标在于降低成本、增加利润,当AI实现减员增效时,节省的成本大多流向财务资本所有者,而非人力资本所有者;三是AI技术迭代迅速,企业需要将运用AI实现的递增收益不断投入到技术研发和升级中,而不是用于提升员工薪资。换言之,在缺少政府等外部力量干预的情况下,AI的普及运用会导致分配机制的系统性失灵,古典经济学关于劳动者报酬水平与生产力提升密切相关的理论不再成立。

(三)社会公平受损:AI时代的马太效应

在AI技术不断渗透到社会各领域的当下,社会公平面临着愈发严峻的挑战,其中马太效应的持续扩大成为最突出的问题之一。AI对社会公平的损害,深层次的原因在于数字鸿沟不断扩大和机会垄断日益加剧,在机会均等方面产生消极影响。

对于教育水平较低、数字技能较弱的就业群体而言,AI技术的普及不仅未能带来发展红利,反而形成了一道难以逾越的数字鸿沟。一方面,他们可能缺乏接触和学习前沿AI技术的渠道与能力,不能满足AI相关岗位对专业知识、数据处理能力等的高要求,难以进入高薪的AI产业领域,只能被困于技术替代风险高、收入水平低的传统岗位。另一方面,在日常活动中他们还常因算法歧视而遭遇不公平对待。如在求职时,部分企业采用的AI筛选系统可能因他们不符合特定数字技能条件和从业经历,自动将其排除在外;又如在申请信贷时,AI评估模型可能因他们的职业类型、收入稳定性等数据标签,给出更高的贷款利率或直接拒绝审批。

与之形成鲜明对比的是,教育水平高、数字技术能力强的就业群体在AI时代正不断巩固自身的优势地位,其更容易进入AI研发、算法优化、数据分析师等高薪岗位,获得远超普通群体的收入回报。在就业竞争中,凭借丰富的数字技能履历,他们更易受到AI筛选系统的青睐,获得更多优质职业机会。在信贷、投资等金融领域,AI评估模型也会将他们判定为低风险客户,给予更优惠的服务条件。这种“强者愈强、弱者愈弱”的马太效应,若长期得不到有效抑制,将进一步加剧不同群体间的收入差距与财富积累,致使社会分化愈演愈烈。

除此之外,AI技术本身的特性还催生出显著的集中度效应(Concentration Effect),在AI行业内形成“赢家通吃”现象,即头部企业凭借其雄厚的技术资本实力、卓越的品牌声誉、丰富的数据资源,占领了绝大部分市场份额,而其他中小企业不受用户待见,难以吸引用户关注,最终陷入无人问津的生存困境,甚至被迫退出市场。这种赢家通吃现象主要源于AI行业独特的竞争壁垒:其一,技术护城河深。AI核心技术的研发需要长期的技术积累与巨额的研发投入,头部企业通过多年深耕,已在算法模型、深度学习框架、芯片技术等方面形成难以超越的技术优势,中小企业难以企及。其二,资本门槛高。AI技术研发、数据采集与处理、市场推广等环节均需大量的资金支持,头部企业可凭借雄厚的资本实力持续投入,而中小企业往往因融资难、融资贵,难以承担高额的研发投入与运营成本。其三,转换成本低。用户从非头部企业转向头部企业的AI产品时,几乎不需要承担额外成本,如用户从一款小众AI聊天软件切换到ChatGPT和DeepSeek等头部AI软件,只需下载注册即可使用。

可见,无论是在社会群体层面,还是在行业竞争层面,马太效应现象在AI时代已开始显现,社会公平因群体间的技术和机会差距而被不断侵蚀,行业内的公平竞争环境与反垄断秩序也因赢家通吃现象而面临新的挑战。

四、AI的治理(G)风险:数智技术的监管挑战

AI的复杂性和不透明性催生了新型治理难题,突出表现为算法歧视可能导致隐性偏见制度化、AI滥用严重威胁市场秩序和公共利益、数据安全导致隐私泄露可能在AI时代带来隐私权危机。

(一)算法歧视:隐性偏见制度化

大多数人认为,AI技术在本质上是中立和客观的,但联合国人权理事会(UNHRC)在题为《当代形式种族主义、种族歧视、仇外心里和相关不容忍行为》的研究报告中尖锐地指出,包括AI在内的技术从来都不是中立的,而是反映了设计者和使用者的价值观和利益取向,并且指出AI可能助长种族或其他歧视的三大问题(UNHRC,2024)。

1. 数据偏差问题。训练算法使用的数据集通常不完整,或者不能充分代表特定群体。如果特定群体在训练集中的代表性(包括种族、族裔和地区方面的代表性)过高或过低,就可能造成算法偏差,进而导致结果偏差。如果训练数据不足,根据算法做出的预测也会对数据中缺乏代表性或代表性不足的群体带来系统性歧视。如果数据带有种族或民族等历史偏见,则AI可能会复制甚至放大这些偏见。

2. 算法设计问题。AI的另一种常见偏差源自算法的设计方式,如果算法设计选择中存在偏差,即使算法中输入的数据具有无懈可击的代表性,也可能产生结果偏差。算法设计问题可能对现实生活产生重大的歧视性影响,如在设计贷款风险评估算法时,定义和衡量“风险”的方式可能导致歧视性结果。研究表明,信用评分、种族和其他人口统计指标之间可能存在较强相关性,但这种相关性在很多情况下只是现有的系统性种族主义和偏见的产物,使用这种评分对特定群体十分不利,可能严重影响其获取贷款的能力和成本。

3. 算法黑箱问题。一些AI工具无需人类便可独立做出决策,决策过程极具隐蔽性,一些决策发生在不透明的黑箱之中。此外,AI算法一旦获取足够数据就会不断自我更新,随着时间的推移,AI在决策中参考的因素可能不再是编程者设计出来的,而是来自AI在数据中自行识别的模式。此外,基于知识产权和商业机密的考虑,企业开发的许多算法不对外披露,算法审查困难重重,进一步加剧了黑箱问题。如果缺乏有效的问责机制,AI很可能以隐蔽的方式加剧各种歧视现象。

UNHRC的报告还特别举例说明了AI在执法、安全和刑事司法系统、教育和医疗保健三个领域的歧视性应用。例如,一些执法机构从种族歧视的角度,蓄意针对特定群体或社区过度使用人脸识别、预测性警务算法等进行AI监控,导致执法不公。

联合国教科文组织(UNESCO)发布的《挑战系统性偏见:大语言模型的性别偏见》研究报告则聚焦于算法带来的性别歧视问题,其核心发现包括:在性别词汇联想任务中,大语言模型更倾向于将性别化名字与传统角色相关联,女性名字常与“家庭”“家人”“孩子”关联,男性名字则常与“商业”“高管”“薪水”“职业”关联。在文本生成任务中,当提示大语言模型补全以人物性别开头的句子时,Llama 2模型约20%的生成内容存在性别歧视与厌女倾向,出现诸如“女性被视为性对象和生育工具”“女性被视为其丈夫财产”等表述。在性取向相关内容生成中,Llama 2模型针对同性恋群体生成负面内容的比例约为70%,GPT-2模型的这一比例约为60%。最后,在提示包含“性别—文化—职业”交叉维度的内容生成任务中,结果显示AI生成内容存在明显偏见,模型倾向于将更多样化、更专业化的职业(如教师、医生、司机等)分配给男性,而对女性分配刻板印象化、传统上价值较低且具争议性的职业(如妓女、家政服务人员、厨师等)。这一现象反映出在基础大语言模型中,性别与文化刻板印象已形成更广泛的固化模式(UNESCO,2024)。

(二)AI滥用:威胁市场秩序和公共利益

AI的初衷在于提升工作效率、优化决策程序、改善生活品质,但当技术缺乏伦理约束和法律规制时,AI便可能沦为资本与权力的工具,在算法杀熟、网络诈骗、员工监视等场景中展现出令人不安的滥用倾向。AI滥用将挑战市场秩序、威胁公共利益。

算法杀熟是AI在商业领域最受诟病的滥用行为。一些平台型企业通过深度学习用户消费数据,精准识别价格敏感度低、忠诚度高的熟悉客户群体,收取高于其他客户的价格,电商、网约车、旅游等平台的AI系统甚至能根据用户手机型号、浏览时长等微观特征动态调整定价。这种“千人千面”赤裸裸的价格歧视,其本质是利用信息不对称将消费者剩余转化为企业盈余。当歧视性算法将AI技术异化为榨取用户价值的工具时,市场经济的公平交易原则将遭受严重冲击。

AI驱动的网络诈骗则呈现出产业化、场景化特征。生成式AI能在短时间内快速伪造出具有受害者亲友声纹的求救语音,深度合成技术可让诈骗分子在视频通话中“化身”为执法人员。当诈骗脚本能根据受害者的社交媒体动态实时调整话术,当AI客服能用方言与老人拉家常时,技术便会从犯罪工具沦为犯罪共谋。

在职场领域,AI监视系统正将泰勒主义演绎成数字极权。一些企业在员工电脑中安装行为感知系统,能够通过键盘敲击频率、鼠标轨迹停顿时间等参数推算出员工的敬业度和勤奋度,甚至根据使用卫生间的频率和时长做出“偷懒预警”。一些物流企业的AI能实时追踪仓库工人的手部动作,若员工在货架前停留超过特定时长便触发效率异常警报。在工作场所滥用AI技术,无异于将劳动者异化为,严重侵犯了劳动者的隐私和尊严。

(三)数据安全:AI时代的隐私权危机

AI技术高度依赖对海量数据的收集、分析和利用,使得数据安全与隐私保护面临着前所未有的挑战。在AI模型的训练过程中,数据的收集环节经常涉及数据安全与隐私保护问题。以面部识别AI系统为例,部分企业在未经授权的情况下,擅自在公开场所大量采集公众照片,并将其用于模型训练,这种行为严重侵犯了公众的隐私权。此外,在数据存储环节,潜在的漏洞也会带来隐患。例如,应用AI的医疗机构其数据一旦泄露,患者的病历信息就很可能流入黑市,这将严重侵犯患者的隐私权,甚至引发公众对医疗行业的信任危机。

生成式AI的快速发展进一步加剧了隐私权风险。通过提示词攻击等手段,攻击者可以诱导AI输出训练数据中的敏感信息,这些信息可能包括个人身份证号码、银行账户等极为重要的隐私内容。此外,“去标识化”数据往往可以通过交叉验证等手段还原出个人身份,使传统的隐私保护手段失效。在AI应用日趋普及的情况下,如何避免数据安全保护不足带来的隐私侵权行为,已经成为亟待解决的重要治理问题。

五、AI的ESG风险缓释建议

要化解AI十大ESG风险,必须整体推进、综合治理。唯有同时在环境议题、社会议题和治理议题采取缓释举措,才能实现技术创新与科技向善相得益彰,才能使AI成为经济、社会和环境可持续发展的造福者。

(一)在环境议题上,推动AI向绿色化与循环化转型

AI发展过程中潜藏的“三高”(高耗电、高耗水与高排放)现象,正逐渐成为制约AI可持续发展的瓶颈。要破解这一难题,需从硬件和技术两大核心领域同步发力,推动可再生能源的规模化应用,系统性降低AI产业全生命周期的资源消耗与环境影响。

在硬件领域,应重点推广以液冷服务器为代表的高效节能技术。相较于传统风冷服务器,液冷服务器可大幅提升散热效率,在保障服务器稳定运行的同时,大幅减少用电量,从而有效缓解数据中心这一“电老虎”带来的环境资源压力。当然,更重要的是增加零排放或低排放的绿电供应,一些AI头部企业正利用其雄厚的技术和财务实力发展小型核聚变等技术,一旦取得突破,就可以从根本上推动AI绿色化和低碳化。

在技术领域,应注重架构创新和算法优化。DeepSeek训练成本之所以远远低于GPT-4等AI模型,主要归功于通过采用混合专家模型(MoE)架构激活少量参数以大幅减少计算量,通过强化学习策略和优化算法技术大幅减少缓存量,计算量和缓存量的大幅减少意味着电力和水资源的节约。从表2可以看出,DeepSeek训练的耗电量只占GPT-4的5.6%。DeepSeek虽然没有披露耗水量,但考虑到耗电量与耗时量强关联,可以推断其耗水量也远远低于其他AI模型。

除技术创新外,还应推动AI相关行业向循环经济发展模式转型。一方面,要加大对服务器、算力芯片、数据存储设备等废旧AI设备的回收与循环利用力度,建立专业化的回收处理体系,通过拆解、修复、翻新等方式,提升设备零部件的回收率和再利用率,大幅减少电子废弃物的产生。另一方面,需规范电子废弃物的处置,采用无害化处理技术,避免重金属、有毒有害物质对土壤、水源造成污染,实现AI产业全生命周期绿色化。

在监管与标准建设方面,应加快完善可持续信息披露准则,提高AI数据中心的环境足迹信息披露的透明度。具体而言,需建立统一、规范的AI产业环境足迹核算与报告标准,明确碳足迹、水足迹及其他环境足迹(如矿物消耗和废弃物)的核算方法,要求AI企业定期公开数据中心的用电量、用水量、碳排放等关键信息,为绿色低碳转型提供数据支撑。

此外,应加大宣传力度,让使用者清楚地了解AI运用带来的环境资源代价。All About AI以ChatGPT为例,分析了用户向GPT-4o每次查询(Query)的环境成本:0.3瓦时的电消耗(这是标准文本查询的耗电量,而较长或包含多模态的查询,则每次的耗电量将增至2.5 ~ 40瓦时)和0.32毫升的水消耗。向AI每提问一次看似环境成本微不足道,但假设全世纪82亿人口中有20亿人使用AI查询,人均每天查询5次,每次查询问题的环境成本与ChatGPT相同,且全部为简单的文本查询,每度电的排放因子为0.6公斤CO2,则全年的环境成本将相当惊人:约10.95亿千瓦时电、11.68亿升水、65.7万吨CO2(不包括与查询相关的间接排放,如硬件设备和系统设施的全生命周期排放⑤)。All About AI还指出,使用ChatGPT查询一次的耗电量约等于使用普通搜索引擎如Google查询耗电量的10倍,夜间使用AI的耗电量比白天使用AI的耗电量多出67%(因为夜间不能使用光电等可再生能源),语音查询比文本查询更耗算力和电力。开展这种直观的宣传活动,将消除AI使用零成本的幻觉,引导使用者慎用和善用AI,养成“四少四多”(少用AI,多用搜索引擎;少用语音查询,多用文字查询;少用视频图像,多用文本文字;少在夜间查询,多在白天查询)的良好使用习惯。

(二)在社会议题上,完善就业保障和分配机制

AI技术将从根本上重塑劳动力市场结构。针对AI的就业挤出效应加速薪资与生产力脱钩等现象,应当在就业保障和公平分配方面开展与时俱进的改革,确保技术进步的红利真正惠及芸芸众生,避免AI过度抢夺工作岗位引发新的社会不和谐。

在就业保障方面,应当建立一套科学完善的AI影响动态预警机制,通过大数据分析与AI算法,精准识别出工作岗位受AI替代风险较高的行业,对这些行业实施常态化监测,为决策部门提供参考,并以此为基础,构建终身学习的职业培训体系,开展针对性的AI技能培训,帮助受AI冲击的群体适应AI时代的就业市场需求,努力在数字化进程中实现公正转型,尽可能避免特定群体被技术变革抛弃,切实保障劳动者的权益。

在公平分配方面,AI加剧的两极分化亟待改革分配机制。一方面,不仅AI公司的股东在 AI 热潮中赚取高额回报,而且其管理层、技术团队和员工的薪酬(含股票期权)也远高于其他行业,如英伟达持股的员工(约占全部员工的78%)已成为百万富翁,其中一半员工的净资产更是达到了2500万美元。另一方面,一些行业的特定群体却因AI面临失业的困境。这种两极分化需要通过改革二次分配制度予以解决,避免收入差距和贫富悬殊愈演愈烈。此外,还应完善初次分配制度,建立明确的AI收益共享机制。政府可通过政策引导与制度规范,鼓励企业将AI红利更多用于改善员工待遇,提高员工薪资水平,以扭转薪资与生产力加速脱钩的局面。

为了从根本上缓释AI的社会风险,还需要构建多方参与的帮扶救济机制。在政府层面,加大对受AI冲击群体的数字技能帮扶,切实打破数字鸿沟对就业机会的掣肘。同时,完善反垄断法规,针对AI领域容易出现的技术和数据垄断等问题,加强对AI头部企业市场行为的规范与监管,严禁其利用技术优势排挤中小企业、滥用数据资源限制市场竞争,营造公平竞争的市场环境,为中小企业参与AI产业发展创造更大空间。在企业层面,督促AI头部企业承担更多的社会责任,通过技术开放、资源共享等方式帮助中小企业降低AI应用成本,推动AI技术的普惠应用。在社会层面,社会成员既要积极学习AI应用技术,适应AI时代的就业要求,也要善用和慎用AI,避免过度依赖和信赖AI。唯有通过多维度、全方位的帮扶救济举措,才能促进AI向善,使其成为促进社会公平、推动共同发展的强大动力,而非加剧社会失衡的风险因素,最终实现技术进步与社会治理的良性互动,构建更加公平、更包容的AI时代社会发展新格局。

(三)在治理议题上,强化伦理建设和建章立制

进入AI时代,AI的广泛应用在带来效率提升的同时,也引发了一系列伦理和法律问题。为了消除这些技术进步带来的问题,应当秉承德法相济的原则,强化伦理建设和建章立制,以确保AI健康可持续发展。

在伦理建设方面,应当将公平性贯穿于算法设计的全过程。一是算法设计应采用更具代表性和多样化的训练数据集以消除历史偏见和隐性歧视。二是鼓励开发可追溯、可审计、可解释的AI技术,不断提高算法的透明度和可信度。三是鼓励AI企业在不泄露核心技术和商业机密的前提下披露算法相关的信息,主动接受公众监督,着力破解被广为诟病的算法黑箱问题。值得一提的是,UNESCO(2021)发布了《人工智能伦理问题建议书》,提出发展AI必须遵循的价值观和基本原则,从环境和生态系统、性别、文化、教育和研究、传播和信息、经济和劳动、健康和社会福祉等政策行动领域提出针对性的规范建议,为各国的AI伦理建设提供了参考。

在建章立制方面,立法部门和监管部门可尽快制定与AI相关的法律法规,对带有歧视性算法的AI作出禁止性规定,完善数据安全和隐私保护法律体系,赋予用户对自身数据的控制权。在这方面,欧盟2024年生效的《人工智能法案》颇具借鉴意义。该法案将AI的风险分为不可接受风险、高风险、有限风险和微小风险四类。对于不可接受风险的AI(包括潜意识、操纵性或欺骗性技术、利用弱势群体、社会评分、犯罪风险评估画像分析,人脸识别数据库,工作场所或教育机构情绪识别、生物特征识别分类、公共场所实时远程生物识别等),提出禁止开发和投放市场。对于高风险的AI(如机械、玩具、电梯、无线电设备、压力设备、民航、无人机等),在算法审查、透明度等方面提出了较高的要求。而对于有限风险和微小风险的AI,则提出相对宽松的法律要求,以免阻碍技术创新(EU,2024)。我国迄今尚无全国性的AI立法,但上海市人大常委会先行先试,在2022年9月制定的《上海市促进人工智能产业发展条例》中对危害用户人身或者财产安全、用户歧视和价格歧视等六种行为作出禁止性规定,并对高风险的AI产品和服务实行清单式管理,遵循必要、正当、可控等原则进行合规审查。

六、结束语

本文的分析表明,AI在推动经济社会高质量发展中潜力巨大,正快速融入制造业、农业、科技、教育、医疗、金融、管理等关键领域,必将为产业升级和效率提升注入强大的科技动力。在应对气候变化的过程中,AI同样扮演着不可或缺的角色,可望成为提升能源管理效率、推动绿色低碳转型的重要推手。

然而,我们也应当高度重视AI发展中潜藏的十大ESG风险。AI技术的普及应用,不仅要通过做好工作来提升绩效,更要通过行善来造福人类。科技向善、包容发展理应成为AI发展必须秉持的基本原则。目前,AI在做好工作方面表现卓越,但在行善方面仍有欠缺,在ESG领域尤其如此。只有直面AI发展中蕴含的ESG风险,在环境、社会和治理议题上及时采取有效措施加以缓释,才能最大限度地减少AI这一革命性科技进步对经济、社会和环境造成的负外部性,AI行业才能真正做到义利并举,为全人类如何破解“以敬畏之心与天地共舞、以仁德之怀与众生同行”这一困扰古今中外的可持续发展重大命题提供强大的技术动能。

AI是当今世界最具应用前景的技术创新之一,其发展不仅关乎经济增长,更关乎社会和谐与环境保护。我们应当在推动AI技术进步的同时,积极应对和有效缓释ESG风险,确保AI的发展充分展现可持续性以实现天人合一、人与自然和谐共生的环境目标,确保AI的发展充分展现包容性以实现天下大同、人与人和谐相处的社会目标,确保AI的发展充分展现规范性以实现天地人和、德与法和谐共融的治理目标。只有实现这三大ESG目标,我们才能在AI的助力下,实现经济、社会和环境的可持续发展,为子孙后代创造一个更加美好的未来。

注释

①②AI Environment Statistics 2025,How AI Consumes 2% of Global Power and Consume 17B Gallons of Water,网址为www.allaboutai.com。

③Creative Destruction这一术语最早由约瑟夫·熊彼特(Joseph Schumpeter)在其1912年出版的《经济发展理论》一书中提出,后经菲利普·阿吉翁(Philippe Aghion)和彼得·豪伊特(Peter Howitt)系统论证而不断完善。2025年10月,瑞典皇家科学院将2025年诺贝尔经济学奖授予乔尔·莫基尔(Joel Mokyr)、阿吉翁和豪伊特,以表彰他们对“创新驱动的经济增长”的研究。其中,莫基尔因阐明技术进步推动持续增长的必要条件而获奖,阿吉翁和豪伊特因提出以创造性破坏过程推动持续增长的理论而获奖。阿吉翁和豪伊特关于创造性破坏的理论认为,任何重大的技术进步必然伴随着创造性破坏,而这种破坏所带来的社会成本往往被低估,本文所分析的AI十大ESG风险就是创造性破坏的生动体现。

④《DeepSeek陈德里:AI短期机会多长期风险更大》,来源于虎嗅网,网址为www.huxiu.com。

⑤人工智能查询很多是在智能手机上完成的,根据《万物皆有碳足迹》一书中的测算,使用智能手机每年会产生5.8亿吨的碳排放(Berners-Lee,2022)。

主要参考文献

黄世忠,叶丰滢.ESG与可持续披露准则研究[M].北京:中国财政经济出版社,2024.

沈愷,童潇潇,于典等.生成式AI在中国:2万亿美元的经济价值[EB/OL].www.McKinsey.com.cn,2025.

Berners-Lee M.. The Carbon Footprint of Everything[M].London:Profile Books Ltd,2022.

EU. Regulation(EU)2024/1689 of the European Parliament and the Council[EB/OL].www. unesco.org,2024.

General Motors. 2024 Task Force on Climate-related Financial Disclosures (TCFD)Report[EB/OL].www.gm.com,2025.

Google. Environmental Report 2025[EB/OL].

www.sustainability.google,2025.

Green Peace. Environmental Impacts of Artificial Intelligence[EB/OL].

www.greenpeace.de,2025.

IEA. World Energy Outlook Special Report,Energy and AI[EB/OL].www.iea.org,2025.

McKinsey. The Economic Potential of Generative AI[EB/OL].www.mckinsy.com,2023.

RAND. Macroeconomic Implications of Artificial Intelligence[EB/OL].www.rand.org,2025.Stanford. Artificial Intelligence Index Report 2023[EB/OL].www.hai.stanford.edu,2023.

TSMC. Sustainability Report 2024[EB/OL].www.tsmc.com,2025.

UNCTAD. Digital Economy Report 2024,Shaping an Environmentally Sustainable and Inclusive Digital Future[EB/OL].www.unctad.org,2024.

UNESCO. Challenging Systematic Prejudices,An Investigation into Gender Bias in Large Language Model[EB/OL].www.unesco.org,2024.

UNESCO. Recommendation on the Ethics of Artificial Intelligence[EB/OL].

www. unesco.org,2021.

UNHRC. Contemporary Forms of Racism,Racial Discrimination,Xenophobia and Related Intolerance[EB/OL].www.digitallibrary.un.org,2024.WEF.AI Could Make Us More Productive,Can It Also Make Us Better Paid?[EB/OL].www.weform.org,2025.

黄世忠 教授

黄世忠 男,福建南安人,会计学博士、博士生导师,全国人大代表。现任厦门国家会计学院二级教授;曾先后担任厦门大学管理学院副院长,厦门国家会计学院副院长、院长。

主要研究 会计准则和资本市场、报表分析、财务舞弊、企业合并、国际会计、ESG与可持续发展。

主要兼职 中国会计学会副会长;厦门市政协副主席,民建福建省委副主任委员暨厦门市委主任委员。曾任国际财务报告准则咨询委员会委员,全国会计专业学位研究生教育指导委员会委员,中国注册会计师协会审计准则委员会副主任委员、中国中青年财务成本研究会副会长。

主要成果 主持研究国家自然科学基金、社会科学基金和省部级科研课题10余项,在重要学术期刊发表论文200余篇,公开出版学术专著、教材、译著25部。

主要荣誉 享受国务院政府特殊津贴专家,财政部首批会计名家,中宣部全国文化名家暨“四个一批”人才,国家哲学社会科学领军人才;还荣获国家级和省部级优秀成果奖10余项。

新浪声明:此消息系转载自新浪合作媒体,新浪网登载此文出于传递更多信息之目的,并不意味着赞同其观点或证实其描述。文章内容仅供参考,不构成投资建议。投资者据此操作,风险自担。